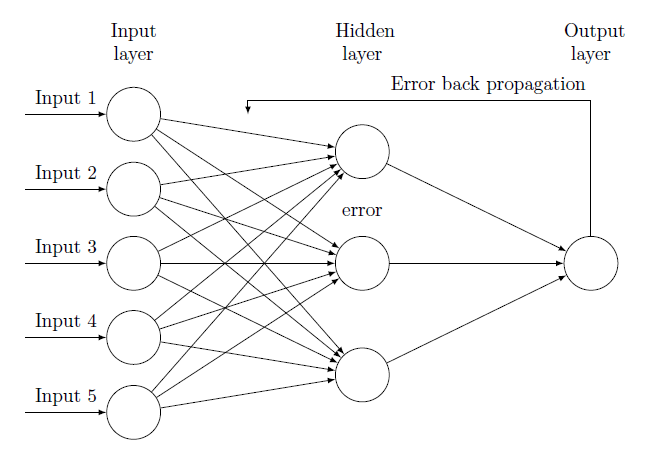

신경망 학습의 목적은 손실 함수의 값을 가능한 한 낮추는 매개변수를 찾는 것입니다. 이는 곧 매개변수의 최적값을 찾는 문제이며, 이러한 문제를 최적화(optimizer)라고 합니다. 하지만 신경망 최적화는 어려운 문제입니다. 매개변수 공간은 매우 넓고 복잡해서 최적의 솔루션은 쉽게 찾지 못하기 때문입니다. 그래서 순식간에 최솟값을 구하는 방법은 없습니다. 게다가 심층 신경망에서는 매개변수의 수가 엄청나게 많아져서 사태는 더 어려워집니다. 앞으로 다룰 것은 이러한 어려운 최적화 방법론에 대해서 다루고자 합니다. 최적화 방법론(optimizer) : 모멘텀 모멘텀은 '운동량'을 뜻하는 단어로 물리와 관계가 있는 개념입니다. W는 갱신할 가중치 매개변수, n은 학습률, n옆에 있는 것은 W에 대한 손실함수의 ..