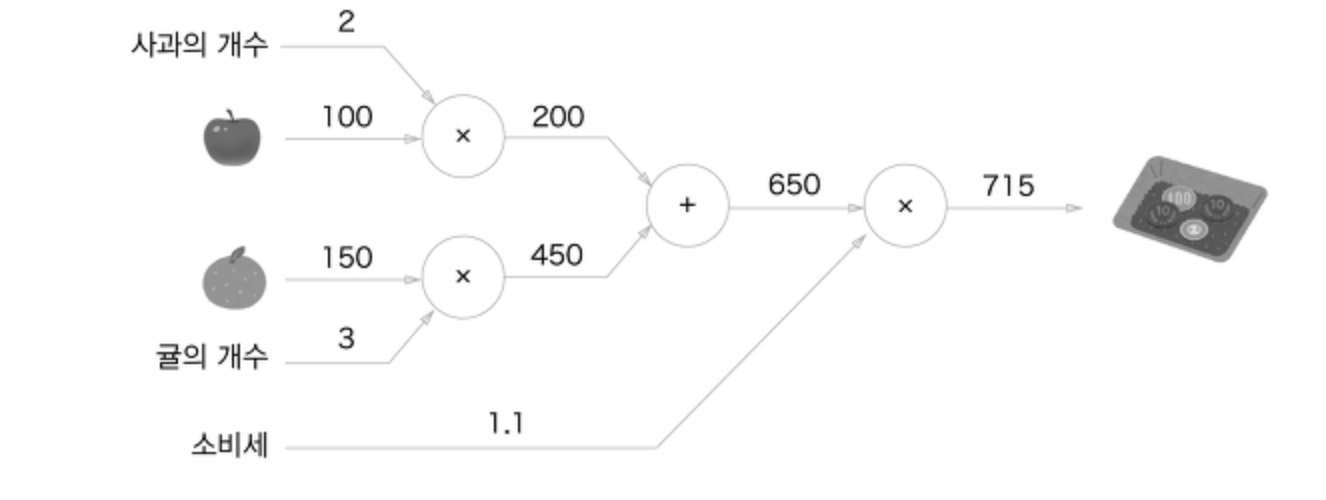

오차역전파 수치미분 vs 연쇄법칙 + 미분공식(오차 역전파 해당) 수치미분은 단순하고 구현하기 쉽지만, 계산 시간이 오래 걸린다는 것이 단점입니다. 그래서 가중치 매개변수의 기울기를 효율적으로 계산하는 오차역전파에 대해 배워보고자 합니다. 순전파를 통해 도출된 오차를 순전파의 역방향으로 가면서 오차를 줄일 수 있는 매개변수를 찾아가며 갱신하는 방법 실제값과 예측값의 거리(차이) = 손실함수의 값을 통해, 역으로 편미분을 통해 손실이 적어지는 최적의 매개변수를 구하는 것 알고리즘의 이해 1. 학습할 신경망을 구성/선택 2. 가중치 랜덤 초기화 3. 순전파를 통해 출력층에 도달, 출력값 확인 4. 비용함수를 계산 5. 비용함수를 최소화하는 가중치를 찾는다 6. 역전파를 통해 입력층으로 돌아오면서 비용함수를 ..